Studiu de caz: Moderarea conținutului

Peste 30 de documente web eliminate și adnotate pentru moderarea conținutului

care se străduiesc să securizeze spațiul online în care ne conectăm și comunicăm.

Pe măsură ce utilizarea rețelelor sociale continuă să crească,

problema hărțuirii cibernetice a apărut ca a

obstacol semnificativ pentru platformele care se străduiesc să

asigura un spațiu online securizat. O uluitoare

38% dintre indivizi se confruntă cu acest lucru

comportament dăunător zilnic,

subliniind cererea urgentă de inventiv

abordări de moderare a conținutului.

Organizațiile de astăzi se bazează pe utilizarea

inteligența artificială pentru a aborda durabil

problema hărțuirii cibernetice în mod proactiv.

Securitate cibernetică:

Raportul Facebook privind aplicarea standardelor comunitare din trimestrul IV a dezvăluit – acțiune asupra a 4 milioane de conținut de hărțuire și hărțuire, cu o rată de detectare proactivă de 6.3%

Educație:

A 2021 studiul a constatat că 36.5%% dintre elevii din statele unite cu vârste cuprinse între 12 & 17 ani de zile au suferit la un moment dat sau altul în timpul școlii.

Potrivit unui raport din 2020, piața globală a soluțiilor de moderare a conținutului a fost evaluată la 4.07 miliarde USD în 2019 și era de așteptat să atingă 11.94 miliarde USD până în 2027, cu un CAGR de 14.7%.

Soluție pentru lumea reală

Date care moderează conversațiile globale

Clientul dezvolta un sistem automatizat robust

moderarea conținutului Machine Learning

model pentru oferta sa Cloud, pentru care ei

căutau furnizori specifici domeniului care

i-ar putea ajuta cu date exacte de antrenament.

Folosind cunoștințele noastre extinse în procesarea limbajului natural (NLP), am asistat clientul în colectarea, clasificarea și adnotarea a peste 30,000 de documente atât în engleză, cât și în spaniolă pentru a construi un model automat de moderare a conținutului de învățare automată, bifurcat în conținut toxic, matur sau explicit sexual. categorii.

Problemă

- Web scraping 30,000 de documente atât în spaniolă, cât și în engleză din domeniile prioritare

- Clasificarea conținutului adunat în segmente scurte, medii și lungi

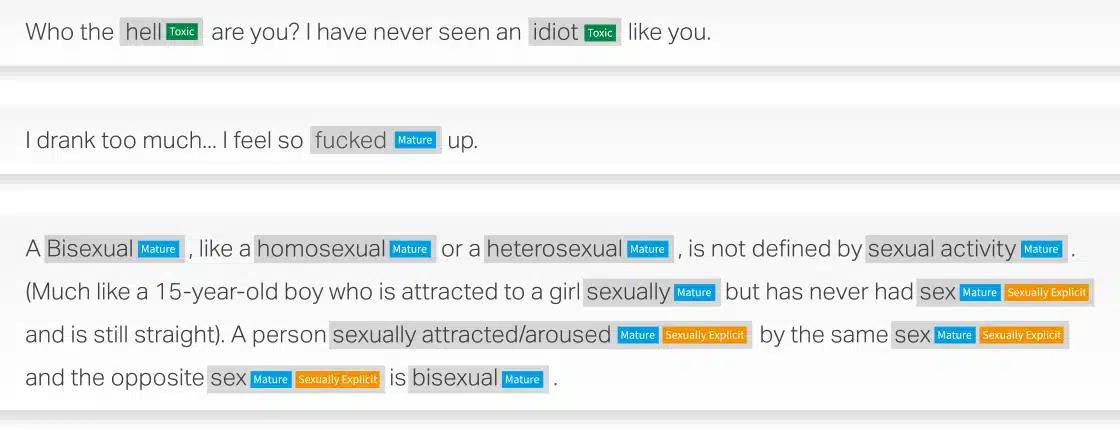

- Etichetarea datelor compilate ca fiind toxice, mature sau sexual explicite

- Asigurarea adnotărilor de înaltă calitate, cu o acuratețe de minim 90%.

Soluţie

- Web S-a casat 30,000 de documente fiecare pentru spaniolă și engleză de la BFSI, Healthcare, Manufacturing, Retail. Conținutul a fost în continuare bifurcat în documente scurte, medii și lungi

- Etichetarea cu succes a clasificat conținutul ca fiind toxic, matur sau sexual explicit

- Pentru a obține o calitate de 90%, Shaip a implementat un proces de control al calității pe două niveluri:

» Nivelul 1: Verificarea asigurării calității: 100% din fișiere trebuie validate.

» Nivelul 2: Verificarea analizei critice a calității: Echipa CQA a lui Shaips evaluează 15%-20% din eșantioanele retrospective.

Rezultat

Datele de instruire au ajutat la construirea unui model ML de moderare automată a conținutului care poate produce mai multe rezultate benefice pentru menținerea unui mediu online mai sigur. Unele dintre rezultatele cheie includ:

- Eficiență în procesarea unei cantități mari de date

- Consecvența în asigurarea aplicării uniforme a politicilor de moderare

- Scalabilitate pentru a se adapta bazei de utilizatori și volumelor de conținut în creștere

- Moderarea în timp real poate identifica și

eliminați conținutul potențial dăunător pe măsură ce este generat - Eficiența costurilor prin reducerea dependenței de moderatorii umani

Exemple de moderare a conținutului

Spuneți-ne cum vă putem ajuta cu următoarea inițiativă AI.